Nieuwe risico's, zelfde technieken

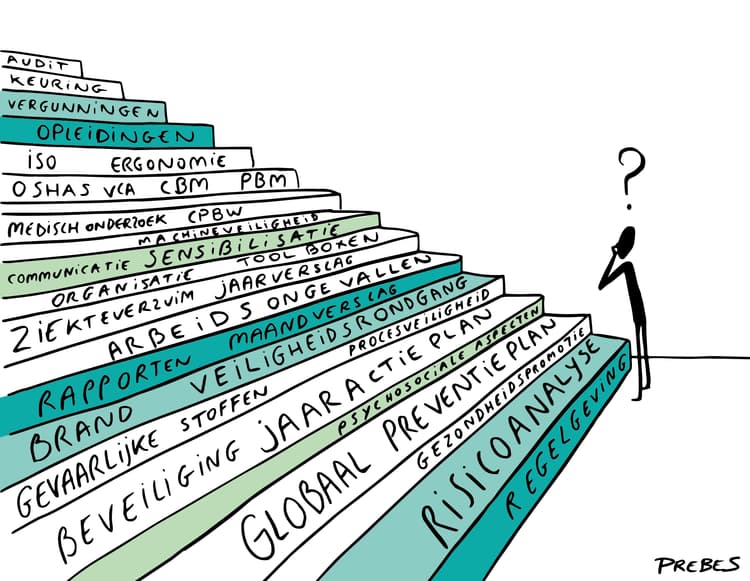

Heel wat preventieadviseurs houden zich op dit moment bezig met het onder controle houden van AI-risico’s op de werkvloer. Aangezien AI nieuwe technologie is – met de bijhorende voor- en nadelen – bestaat de kans dat die risico’s onder- of overschat worden. NIOSH benadrukt dat de gebruikelijke HSE-principes van risico-inventarisatie en -evaluatie (RIE) kunnen worden toegepast. Er hoeft niet gezocht te worden naar nieuwe technieken om de risico’s van AI te benaderen.

Strategie 1: algoritmische hygiëne

Een eerste mogelijke HSE-strategie is die van de zogenaamde “algoritmische hygiëne”: de specifieke systeemkarakteristieken (en gevaren!) van AI worden gewoon gelinkt aan evidente risico’s (zowel fysiek als mentaal) en daar worden dan preventiemaatregelen tegenover geplaatst.

NIOSH geeft daarbij volgende aandachtspunten mee:

- In plaats van AI – een term die nogal vaag en algemeen is – is het beter om te spreken van “getrainde algoritmes” (trained algorithms): op basis van trainingsdata wordt een algoritme uitgewerkt dat dan wordt ingezet als output of gedrag van een systeem.

- Een algoritme op zich is niet gevaarlijk en niet tastbaar; het is pas wanneer het wordt ingezet in een werksysteem dat risico’s (voornamelijk psychosociale) kunnen ontstaan.

- Als HSE-expert kan je de gebruikelijke risicoanalysemethodes gebruiken zoals je doet bij andere gevaren en risico’s. Wel is het mogelijk dat je je moet inwerken in de specifieke karakteristieken van algoritmes en AI-systemen om de RIE voldoende inhoudelijk te voeden.

Strategie 2: een brede RIE

Een tweede mogelijke strategie om AI-risico’s aan te pakken, is om de RIE een beetje open te trekken en te kiezen voor 5 zogenaamde “risk management options”:

- Het zou kunnen dat medewerkers die betrokken zijn bij het managen van welzijn op het werk, zich wat moeten bijscholen om de benodigde kennis en vaardigheden te verwerven om de specifieke risico’s van AI te beheren (bv. bepaalde computervaardigheden om zelf aan de slag te gaan in AI-systemen).

- Er is een samenwerking nodig tussen HSE-professionals enerzijds en AI-ontwikkelaars anderzijds. Het is geen overbodige luxe om samen de risico’s op te sporen en te evalueren. Op die manier leren ontwikkelaars met welke menselijke aspecten ze rekening moeten houden bij het uitwerken van nieuwe systemen.

- Het kan verstandig zijn om te investeren in een onafhankelijke audit van de gebruikte AI-systemen met een specifieke focus op de gezondheid en veiligheid van medewerkers. In deze optiek wordt ook wel eens gesproken van “algoritmische transparantie”.

- Er bestaat ook een mogelijkheid om AI-systemen te laten certificeren, wat ontwikkelaars ertoe kan aanzetten om meer rekening te gaan houden met welzijn op het werk.

- Ten slotte kan worden gebruikgemaakt van 2 specifieke AI-benaderingen tijdens de risicoanalyse:

- de “safety system approach”: dit is een holistische benadering van gevaren en risico’s, waarbij niet zozeer naar individuele componenten wordt gekeken maar eerder de gehele werkomgeving en de systeeminteracties in de RIE worden meegenomen;

- de “safety case approach”: dit is een gedetailleerde en gestructureerde analyse van een specifieke AI-toepassing, die het best omschreven kan worden als “een risicoanalyse op niveau van het systeem”.

Meer informatie

Bron: senTRAL, NIOSH